Shadow IA : le risque invisible qui mine les entreprises

L'usage non contrôlé d'IA par les salariés, ou Shadow IA, expose les entreprises à des fuites de données. Décryptage d'un risque majeur et plan d'action pour le maîtriser.

Le Shadow IA désigne l'utilisation d'outils d'intelligence artificielle par les employés sans supervision, entraînant des fuites de données sensibles. Ce phénomène, lié à la recherche de productivité, expose les entreprises à des risques juridiques et sécuritaires importants, nécessitant une gouvernance IA claire et une formation des collaborateurs.

Sommaire(16 sections)

L'illusion de la productivité : une journée ordinaire à l'ère du Shadow IA

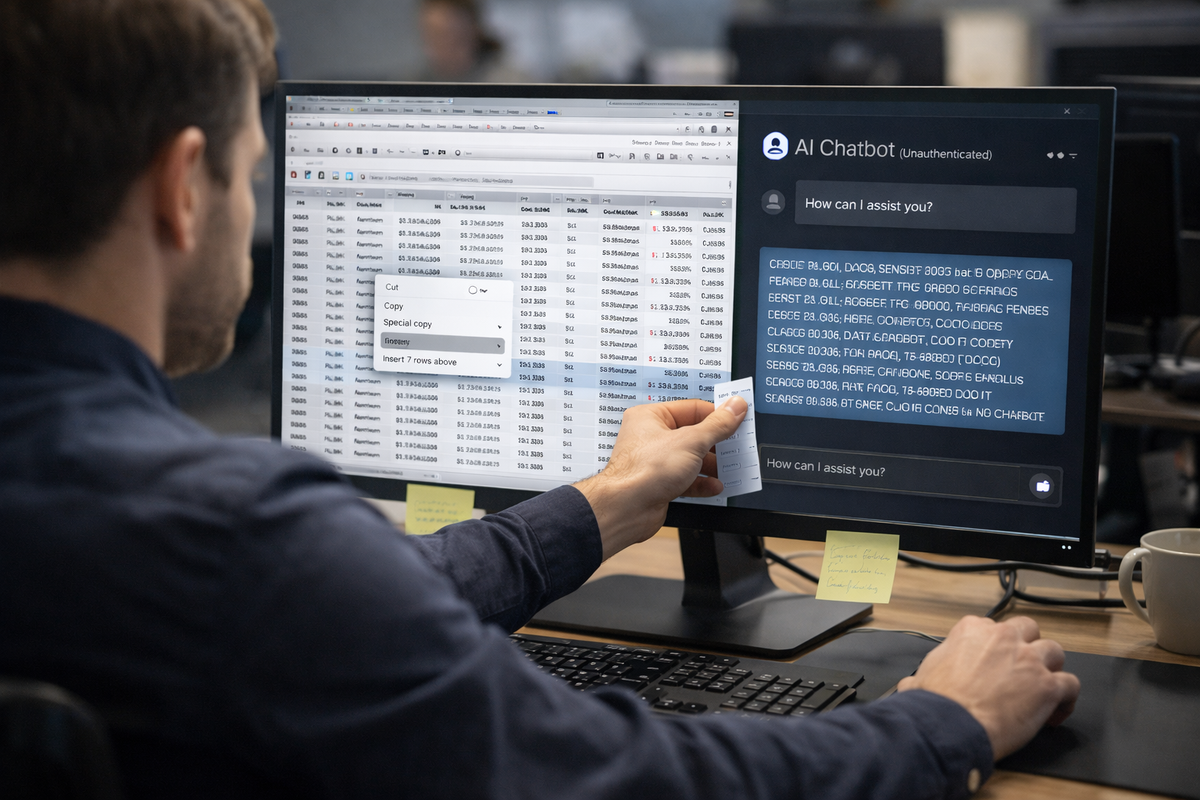

16h45. Le rapport trimestriel doit être envoyé avant la fin de journée. La pression monte. Pour Marc, chef de projet dans une ETI industrielle, le réflexe est désormais automatique. Il ouvre un onglet, copie-colle les données brutes de ventes, des commentaires clients issus du CRM et des extraits de rapports internes dans la fenêtre d'un agent conversationnel grand public. Le prompt est direct : « Rédige une synthèse de 500 mots de ces données pour un comité de direction. Adopte un ton formel et mets en avant trois axes de croissance potentiels. »

Trente secondes plus tard, le texte apparaît. Cohérent, bien structuré. Un simple copier-coller, une relecture rapide, et le travail de trois heures est bouclé en cinq minutes. Marc a gagné du temps, atteint son objectif. Ce qu'il ignore, c'est que les données stratégiques de son entreprise — chiffres de vente, retours clients, analyses internes — viennent d'être ingérées par un modèle hébergé sur des serveurs américains, potentiellement utilisé pour entraîner les futures versions de l'outil. Il a, sans le savoir, externalisé une partie du capital informationnel de son entreprise.

Ce phénomène porte un nom : le Shadow IA. ce phénomène, lié à charte usage IA, ce phénomène, lié à risques IA générative, ce phénomène, lié à sécurité des données IA, ce phénomène, lié à gouvernance IA, il désigne l'utilisation d'outils d'intelligence artificielle par les collaborateurs en dehors de tout cadre, validation ou supervision de la direction des systèmes d'information (DSI). Le rapport « 2024 Data Loss Landscape » de Proofpoint révèle l'ampleur du problème : 78% des employés utilisant l'IA générative y injectent des données sensibles. À l'instar du Shadow IT des années 2010, où Dropbox et Google Drive contournaient les serveurs internes, le Shadow IA est la nouvelle frontière de l'informatique parallèle. Une frontière bien plus poreuse et risquée.

Loin d'être un acte de malveillance, cet usage est le symptôme d'une culture axée sur la performance immédiate, couplée à une gouvernance technologique qui peine à suivre le rythme de l'innovation. Les collaborateurs cherchent l'efficacité avec les moyens à leur disposition. Le problème est que ces moyens, aussi puissants soient-ils, opèrent dans une zone grise juridique et sécuritaire aux conséquences potentiellement dévastatrices.

De l'outil personnel au risque systémique : l'escalade silencieuse

L'adoption du Shadow IA n'est pas un événement brutal mais une infiltration progressive. Elle suit un schéma prévisible en quatre étapes, souvent invisibles pour le management jusqu'à ce qu'un incident survienne. Chaque étape augmente le niveau de risque et la dépendance de l'organisation à des technologies non maîtrisées.

Étape 1 : L'adoption individuelle pour le gain de productivité

Tout commence par une initiative personnelle. Un commercial utilise une IA pour personnaliser ses emails de prospection à grande échelle. Un juriste lui demande de résumer un contrat de 50 pages en identifiant les clauses à risque. Un développeur s'en sert pour déboguer une portion de code récalcitrante. À ce stade, les gains sont tangibles et individuels. La pratique se propage par le bouche-à-oreille, présentée comme une « astuce » pour aller plus vite. L'outil est perçu comme un simple assistant personnel, un « super-Google » inoffensif.

Étape 2 : La normalisation au sein des équipes

Rapidement, l'usage se standardise au sein d'une équipe. Les managers, eux-mêmes sous pression, encouragent implicitement ces pratiques en félicitant la rapidité d'exécution sans questionner les méthodes. Des prompts efficaces s'échangent sur des messageries internes, des modèles de documents générés par IA deviennent la nouvelle norme. L'outil n'est plus une aide ponctuelle, mais un maillon intégré, bien que non officiel, des processus de travail. C'est à ce moment que la dépendance s'installe, souvent sans que l'on ait évalué les alternatives validées et sécurisées comme certains outils d'IA comptable spécialisés.

Étape 3 : La zone grise de la prise de décision assistée

L'étape suivante est plus critique. Les collaborateurs ne se contentent plus de produire du texte ou du code ; ils utilisent l'IA pour analyser des données et orienter leurs décisions. Un analyste financier demande à une IA d'évaluer la rentabilité prévisionnelle d'un projet en se basant sur des données internes. Un responsable RH l'utilise pour présélectionner des CV sur la base de critères qu'il a définis. La décision finale reste humaine, mais elle est fortement influencée par une « boîte noire » dont personne ne maîtrise les biais ou la fiabilité. La traçabilité du raisonnement est perdue.

Étape 4 : Le risque systémique et la perte de contrôle

L'aboutissement est le risque systémique. L'entreprise devient dépendante d'outils externes non maîtrisés pour des pans entiers de son activité. Une modification des conditions d'utilisation, une faille de sécurité majeure chez le fournisseur d'IA, ou une « hallucination » du modèle générant une erreur critique dans un rapport stratégique peut avoir des conséquences en cascade. À ce stade, l'entreprise ne sait plus précisément quelles données sont sorties, quels processus dépendent de ces outils, ni quelle est son exposition juridique réelle. Elle a perdu le contrôle d'une partie de son système nerveux informationnel.

"Faites plus vite" : quand le management sème les graines du Shadow IA

Blâmer les collaborateurs serait une erreur d'analyse. Le Shadow IA est avant tout le produit d'une culture d'entreprise et de défaillances organisationnelles. Il prospère sur un terreau fertile composé de trois éléments : la pression pour la performance, le déficit d'outils internes et la lenteur de la gouvernance.

La pression constante pour la productivité est le premier catalyseur. Une étude de McKinsey sur l'IA générative estime qu'elle pourrait ajouter jusqu'à 4 400 milliards de dollars annuellement à l'économie mondiale. Cette promesse de gains massifs se traduit en objectifs ambitieux au niveau des entreprises. Les salariés, incités à « faire plus, plus vite, avec moins », trouvent dans l'IA la solution miracle. Le management, en valorisant uniquement le résultat final, envoie un message clair : la fin justifie les moyens.

Le déficit d'outils fournis par l'entreprise crée un vide que les solutions grand public comblent. L'attente de plusieurs mois pour le déploiement d'une solution interne, souvent moins intuitive, est un puissant moteur d'adoption du Shadow IA. L'agilité des startups de l'IA contraste avec l'inertie des processus d'achat et de validation des grands groupes. Cette dépendance à des outils externes, souvent américains, pose également la question de la souveraineté de l'IA et du contrôle stratégique des technologies clés.

« Les DSI sont face à un dilemme cornélien », analyse Sophie Duval, consultante en transformation numérique. « Soit elles verrouillent tout et freinent l'innovation, créant de la frustration et encourageant le contournement. Soit elles ouvrent les vannes et perdent le contrôle sur la sécurité et la conformité. La seule voie possible est une gouvernance agile, qui accompagne les usages plutôt que de les interdire frontalement. »

Fuites de données, erreurs amplifiées : les coûts cachés de l'IA fantôme

Les gains de productivité affichés par le Shadow IA masquent des passifs potentiellement colossaux. Les risques ne sont pas théoriques ; ils sont opérationnels, juridiques et stratégiques. Les dirigeants doivent en prendre la pleine mesure pour arbitrer correctement entre agilité et sécurité.

Le spectre de la fuite de données confidentielles

C'est le risque le plus évident. Chaque prompt contenant des informations internes — extraits de code source, données clients, stratégies commerciales — est une potentielle fuite de données. Par défaut, de nombreux services d'IA grand public se réservent le droit d'utiliser les données soumises pour entraîner leurs modèles. Le risque d'exposition est décuplé, et la conformité avec le RGPD devient un casse-tête insoluble. La protection de la propriété intellectuelle via l'IA générative devient alors une gageure.

L'amplification des erreurs et des biais

Les modèles d'IA sont sujets aux « hallucinations » : ils inventent des faits avec un aplomb confondant. Une erreur générée par une IA, si elle n'est pas détectée, peut se propager à une vitesse fulgurante. Un mauvais chiffre dans un rapport peut entraîner une mauvaise décision stratégique. Le Shadow IA transforme une erreur individuelle en un risque systémique, car le même modèle biaisé peut être utilisé par des dizaines de collaborateurs. Ce risque est d'autant plus grand que les techniques de manipulation comme les deepfakes peuvent viser les PME, rendant la vigilance encore plus cruciale.

La responsabilité juridique et réputationnelle

Qui est responsable si une IA génère un contenu qui viole un droit d'auteur, ou produit une analyse discriminatoire utilisée dans un recrutement ? L'entreprise reste en première ligne. L'usage d'outils non maîtrisés l'expose à des risques juridiques complexes. Sur le plan réputationnel, la découverte d'une fuite de données massive orchestrée involontairement par ses propres employés peut être dévastatrice pour la confiance des clients et des partenaires.

- Fuite de Propriété Intellectuelle : Le copier-coller de code source, de plans marketing ou de données R&D dans des IA publiques constitue une externalisation non contrôlée de secrets d'affaires.

- Non-conformité RGPD : L'utilisation de données personnelles de clients ou de salariés dans ces outils sans cadre juridique précis expose l'entreprise à de lourdes sanctions.

- Risque d'erreurs en cascade : Une "hallucination" de l'IA (donnée fausse mais plausible) intégrée dans un rapport peut contaminer toute la chaîne de décision.

- Dépendance technologique invisible : L'entreprise s'appuie sur des processus critiques reposant sur des plateformes externes dont elle ne maîtrise ni la pérennité, ni les coûts, ni la sécurité.

- Perte de traçabilité : Les décisions assistées par IA sans supervision rendent impossible de reconstituer le raisonnement qui a mené à une action, posant un problème de responsabilité.

Reprendre le contrôle : le plan d'action en 90 jours

Face au Shadow IA, l'interdiction totale est une stratégie vouée à l'échec. Elle renforce les pratiques de contournement et prive l'entreprise des gains de l'IA. La solution réside dans une gouvernance agile qui encadre les usages, forme les collaborateurs et fournit des solutions sécurisées. L'objectif est de transformer l'IA d'un risque fantôme en un atout maîtrisé.

« Le leadership éclairé en 2026 ne demandera pas 'Utilisons-nous l'IA ?' mais 'Comment industrialisons-nous l'IA de manière responsable ?' », affirme David Krief, DSI d'un groupe du CAC 40. « Cela passe par l'acceptation que l'innovation vient du terrain. Notre rôle est de la canaliser, de la sécuriser et de la mettre à l'échelle. » Cette philosophie doit se traduire par un plan d'action pragmatique.

Phase 1 (Jours 1-30) : Évaluer et Sensibiliser

La première étape consiste à prendre la mesure du phénomène sans jugement. Il faut comprendre le "pourquoi" avant de définir le "comment".

- Cartographier les usages : Lancez une enquête anonyme pour identifier quels outils sont utilisés et pour quelles tâches. L'objectif est de collecter de l'information, pas de distribuer des blâmes.

- Définir une classification des données : Établissez une typologie simple : publiques, internes, confidentielles, secrètes. Cette grille de lecture est le socle de toute politique de sécurité.

- Lancer une campagne de sensibilisation : Communiquez sur les risques réels du Shadow IA. Expliquez la démarche de l'entreprise : encadrer pour permettre, non interdire pour contraindre.

Phase 2 (Jours 31-60) : Structurer et Outiller

Cette phase construit le cadre et fournit les premières alternatives sécurisées. Il s'agit de créer les garde-fous et les premières autoroutes de l'IA.

- Rédiger une charte d'usage de l'IA (v1) : Co-construisez avec les métiers et le juridique un document simple. Il doit définir ce qui est interdit (ex: utiliser des données clients dans une IA publique), ce qui est autorisé sous conditions, et les bonnes pratiques. Ce cadre s'inscrit dans une logique réglementaire plus large, comme celle du Data Act 2026.

- Valider un premier cercle d'outils : Identifiez et souscrivez à une ou deux solutions d'IA professionnelles qui garantissent la confidentialité des données. Donnez-y accès à un groupe pilote pour tester leur pertinence.

Phase 3 (Jours 61-90) : Déployer et Itérer

La dernière phase vise à généraliser les bonnes pratiques et à installer une culture de l'IA responsable. Gartner prédit que d'ici 2026, les entreprises ayant opérationnalisé la gestion des risques IA verront une adoption de 50% supérieure de leurs modèles.

- Former les équipes et nommer des référents : Déployez des modules de formation obligatoires sur la charte d'usage. Nommez des "référents IA" dans chaque département pour diffuser la culture de la sécurité.

- Mettre en place un processus de validation : Créez un canal simple pour que les collaborateurs puissent proposer de nouveaux outils. Mettez en place un processus d'évaluation agile. Cette démarche proactive est une forme d'intelligence économique appliquée à la technologie.

- Lancez un audit anonyme : Utilisez un formulaire pour comprendre quels outils d'IA sont utilisés par vos équipes et pour quelles tâches spécifiques.

- Élaborez une charte d'usage simple : Rédigez un document d'une page définissant 3 actions à faire et 3 à ne jamais faire avec une IA générative.

- Abonnez-vous à une version "Business" d'un outil majeur : Offrez une alternative sécurisée (ex: ChatGPT Team, Microsoft Copilot for Business) à un groupe pilote.

- Organisez une session de formation d'une heure : Présentez les risques concrets et la nouvelle charte d'usage à l'ensemble des collaborateurs.

- Créez une adresse email dédiée : Mettez en place une boîte mail (ex: `ia-questions@votreentreprise.fr`) où les employés peuvent poser leurs questions sur l'usage de l'IA.

Au-delà de l'outil : l'IA comme compétence, pas comme raccourci En 2026, la simple utilisation de l'intelligence artificielle ne constituera plus un avantage concurrentiel. La véritable différenciation viendra de la capacité des entreprises à les industrialiser de manière propre, sécurisée et responsable. La maîtrise du Shadow IA est la première étape de cette montée en maturité.

L'enjeu dépasse la simple gestion des risques. Il s'agit de transformer une pratique souterraine en une compétence organisationnelle. Former ses collaborateurs à l'art du prompt engineering, à la vérification critique des résultats, et à la compréhension des limites de l'IA est un investissement stratégique. C'est ce qui permet de passer d'une utilisation passive et risquée à une collaboration active et créatrice de valeur. Cette évolution est déjà visible dans certains métiers, où la relation entre l'IA et l'expert-comptable se redéfinit autour de la validation et du conseil à haute valeur ajoutée.

La gouvernance du Shadow IA n'est pas un projet technique, mais un projet de management et de culture d'entreprise. Elle interroge la manière dont la performance est mesurée, l'innovation encouragée et la responsabilité partagée. Les entreprises qui réussiront seront celles qui auront su créer un dialogue de confiance entre les métiers, la DSI et la direction. Elles ne se contenteront pas de "faire de l'IA", elles la penseront, la structureront et la piloteront. C'est à cette condition que la promesse de productivité de l'intelligence artificielle se réalisera sans compromettre la sécurité et la souveraineté de l'entreprise.

Sources & références

Questions fréquentes

Pour aller plus loin

Commentaires

Soyez le premier à commenter cet article.